Apple ha presentato nuovi strumenti di accessibilità che arriveranno nel suo ecosistema nel 2022, secondo Apple. Questo martedì 17 maggio, sappiamo di “Rilevamento porte”, “Mirroring di Apple Watch”, “Sottotitoli istantanei” e altro ancora.

Pur facendo attenzione a non menzionare iOS 16, watchOS 9 o altri aggiornamenti ai loro sistemi operativi, si immagina che queste funzionalità verranno introdotte nella prossima versione del software iPhone e Apple Watch. La grande tecnologia afferma che gli strumenti sono basati sui loro progressi nell’apprendimento automatico.

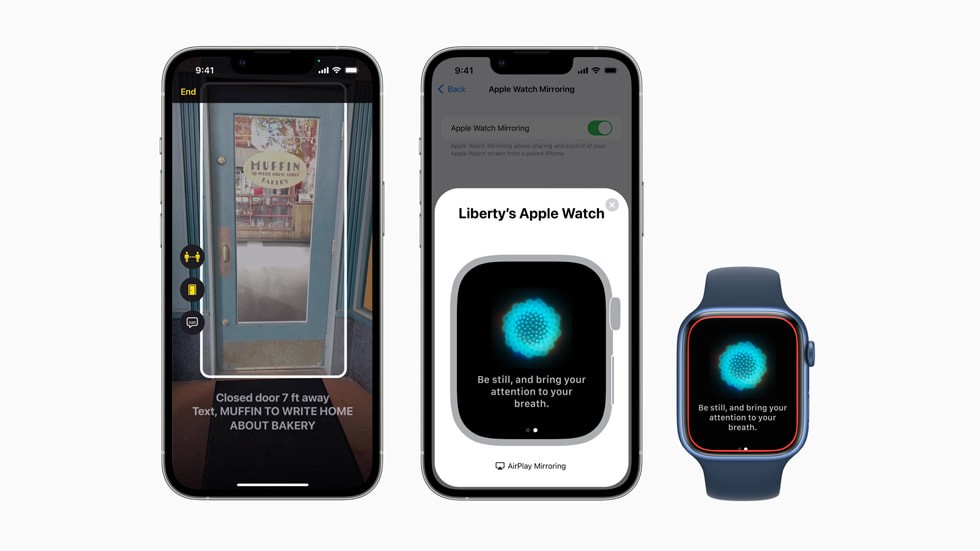

Door Detection consentirà agli utenti ipovedenti di utilizzare le telecamere e il sensore LiDAR su un iPhone o iPad per descrivere tutte le caratteristiche di una porta di fronte a loro. Ciò significa che il software informerà l’utente se la porta è aperta o chiusa, come aprirla ed eventuali segnali di pericolo nelle sue vicinanze.

La funzione di navigazione verrà aggiunta alla lente d’ingrandimento di iOS e iPadOS, insieme alle funzioni per il rilevamento di persone e la descrizione delle immagini, con le quali può funzionare contemporaneamente. E parlando di navigazione, Apple Maps fornirà feedback tattili agli utenti di VoiceOver, facilitando l’identificazione dei punti di partenza.

VoiceOver, tra l’altro, supporterà 20 nuove lingue. Lo strumento per la lettura dello schermo sarà disponibile con voci ottimizzate per le rispettive lingue e aggiungerà uno strumento di correzione di bozze che indicherà gli errori di ortografia.

L’Apple Watch avrà il mirroring dello schermo tramite AirPlay se accoppiato con un iPhone. Questa funzione dovrebbe avvantaggiare gli utenti con disabilità fisiche aggiungendo il supporto per “Controllo vocale” e “Controllo assistivo” all’orologio, che riceverà anche controlli gestuali per rispondere alle chiamate, mettere in pausa la musica e altro.

Per gli utenti con problemi di udito, iPhone, iPad e Mac offriranno ora i “Sottotitoli istantanei”, una funzionalità molto simile alla trascrizione vocale integrata in YouTube e più recentemente in Windows. Nell’ecosistema Apple, questa funzione sarà in grado di convertire la voce in testo nelle telefonate e durante la visione di video.

I sottotitoli automatici saranno presto disponibili in versione beta per iOS, iPadOS e macOS. Inizialmente, l’unica lingua supportata sarà l’inglese e la compatibilità sarà limitata a iPhone 11 e versioni successive, iPad con A12 Bionic e successivi e tutti i modelli di Mac con Apple Silicon.

Sound Recognition, non ultimo, sarà in grado di avvisare gli utenti con problemi di udito quando suona il campanello della loro residenza, ad esempio.

Apple non ha rivelato la data di rilascio esatta delle nuove funzionalità, ma si prevede che saranno disponibili con le prime versioni di prova di iOS 16, iPadOS 16, watchOS 9 e macOS 13. Tali piattaforme dovrebbero essere presentate durante il Worldwide Developers Conference 2022, che si svolgerà dal 6 al 10 giugno.