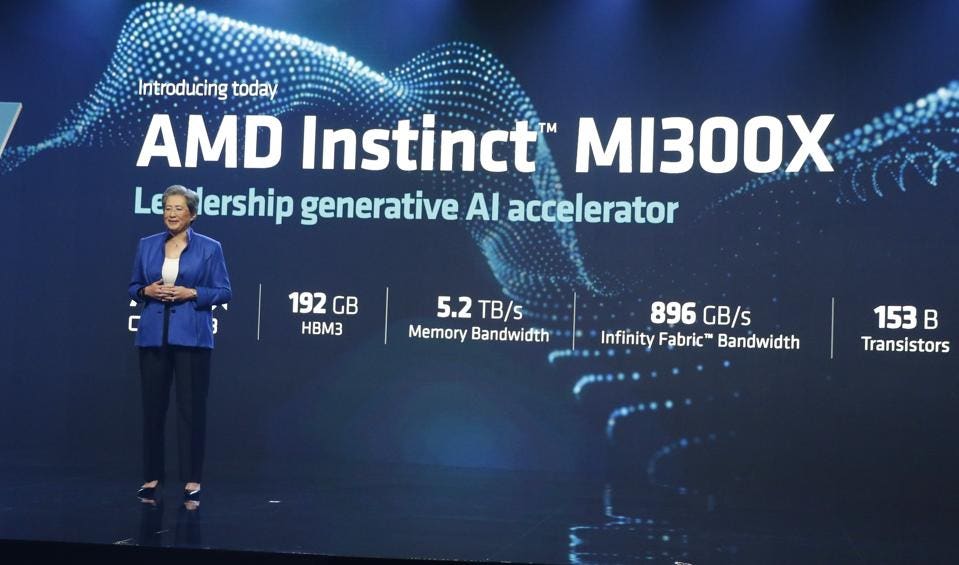

Con prestazioni che superano del 60% quelle del concorrente NVIDIA H100, AMD Instinct MI300X si posiziona come un’innovazione rivoluzionaria nel campo dell’intelligenza artificiale.

In una mossa audace nel mondo dell’intelligenza artificiale, AMD ha lanciato il suo acceleratore di GPU AI di punta, il MI300X. Questo nuovo arrivato promette prestazioni fino al 60% superiori rispetto al rivale NVIDIA H100, segnando un’epoca di cambiamento nel settore.

L’MI300X, parte della serie AMD Instinct MI300, sfrutta le avanzate tecnologie di packaging di TSMC. I benchmark iniziali rivelano una serie di superiorità rispetto a NVIDIA H100, tra cui:

- Capacità di memoria 2,4 volte superiore

- Larghezza di banda della memoria 1,6 volte maggiore

- Prestazioni in FP8 e FP16 TFLOPS superiori del 30%

- Velocità superiore fino al 20% in Llama 2 70B e FlashAttention 2 (1v1)

- Prestazioni fino al 40% e 60% superiori in configurazioni server 8v8

Queste caratteristiche posizionano l’MI300X come una scelta di primo piano per chi cerca prestazioni elevate nell’AI.

Oltre alle prestazioni, AMD sottolinea un rapporto qualità/prezzo competitivo e una superiorità nei carichi di lavoro di inferenza. Il potente MI300X si equipara a NVIDIA H100 in termini di training, ma eccelle nell’inferenza, una caratteristica essenziale per applicazioni AI moderne.

La forza del MI300X risiede anche nel suo software, con l’introduzione di ROCm 6.0. Questo aggiornamento porta nuove funzionalità, supportando formati di calcolo avanzati e migliorando le prestazioni fino a 2,6 volte in vLLM.

MI300X vanta un design unico basato sull’architettura CDNA 3. Il chipset combina IP a 5 e 6 nm, raggiungendo un impressionante totale di 153 miliardi di transistor. Le sue caratteristiche includono:

- 28 die totali, inclusi 8 pacchetti HBM3 e 4 die attivi

- 40 unità di calcolo per GCD, per un totale di 320 unità e 20.480 core

- Memoria HBM3 potenziata: 192 GB contro i 128 GB del MI250X

L’upgrade della memoria è particolarmente notevole, con MI300X che offre una capacità di 192 GB e una banda passante di 5,3 TB/s. Questo confronto mostra chiaramente la superiorità del MI300X nel panorama AI:

- AMD Instinct MI300X: 192 GB HBM3

- Intel Gaudi 3: 144 GB HBM3

- NVIDIA H200: 141 GB HBM3e

Nonostante un consumo energetico elevato di 750 W, l’MI300X resta una scelta potente per configurazioni server avanzate, come dimostrato dalla serie G593-ZX1/ZX2 di Gigabyte.

AMD non è l’unica a competere nell’AI. NVIDIA e Intel stanno sviluppando le proprie soluzioni, come le GPU Hopper H200 e Blackwell B100, e le GPU Gaudi 3 e Falcon Shores. Tuttavia, con l’MI300X, AMD non punta solo a competere, ma a dominare il settore AI.